Famílias de vítimas processam empresa responsável pelo ChatGPT após massacre que resultou em 8 mortes no Canadá

Familiares de vítimas de massacre no Canadá processam a OpenAI por omissão de alertas de segurança.

Familiares das vítimas de um massacre em uma escola de Tumbler Ridge, no Canadá, entraram com um processo contra a OpenAI e seu CEO, Altman, em um tribunal dos Estados Unidos. O ataque, que ocorreu em fevereiro de 2026, resultou na morte de nove pessoas, incluindo várias crianças.

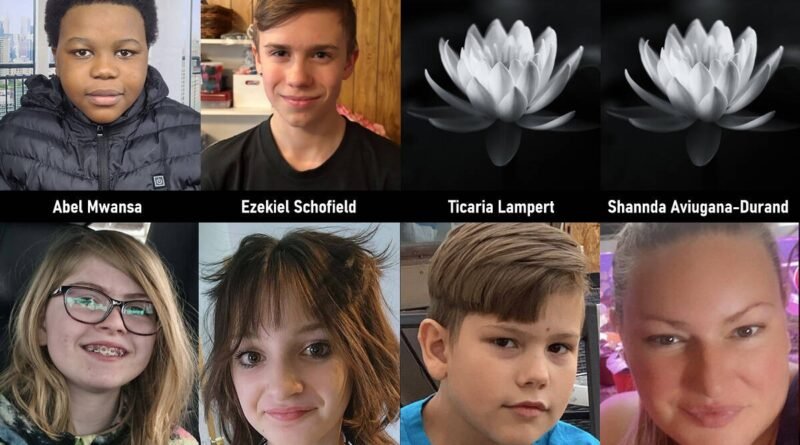

Durante o incidente, a atiradora, identificada como Jesse Van Rootselaar, matou oito pessoas antes de cometer suicídio. Os familiares alegam que a OpenAI já havia identificado a atiradora como um risco potencial, mas não tomou as medidas necessárias para alertar as autoridades.

Os processos, apresentados em São Francisco, afirmam que os líderes da OpenAI não comunicaram a polícia sobre conversas violentas que estavam ocorrendo no ChatGPT, o que poderia ter ajudado a evitar a tragédia. Além disso, os autores do processo sugerem que a empresa estava preocupada com o impacto disso em seus planos de abrir capital na bolsa.

A OpenAI descreveu o tiroteio como uma “tragédia” e declarou que possui uma política de tolerância zero para o uso de suas ferramentas em atos de violência. A empresa também afirmou que já implementou melhorias em suas salvaguardas para responder a sinais de angústia e potencial violência.

Onda de processos

Este caso é parte de um aumento nas ações judiciais contra empresas de inteligência artificial, que enfrentam acusações de não impedir conversas que podem levar a comportamentos autolesivos e violência. Essas são as primeiras alegações nos Estados Unidos que afirmam que o ChatGPT contribuiu para um massacre.

O advogado dos autores do processo anunciou que pretende entrar com mais 20 ações judiciais contra a OpenAI nas próximas semanas, representando outras vítimas afetadas pelo ataque.

Equipe de segurança da OpenAI foi ignorada, dizem ações

Jesse Van Rootselaar, que teve interações com o ChatGPT, cometeu o ataque em sua antiga escola, matando uma assistente educacional e cinco alunos. Ela tinha 18 anos e, após o ataque, também se suicidou.

Entre os autores do processo estão familiares das vítimas e uma sobrevivente de 12 anos que permanece em estado crítico. Os documentos judiciais afirmam que, em junho de 2025, a OpenAI detectou conversas em que a atiradora mencionava violência, mas não tomou as medidas adequadas.

Embora a equipe de segurança tenha sugerido que a polícia fosse notificada, os diretores da OpenAI não seguiram essa recomendação. A atiradora conseguiu abrir uma nova conta e continuou utilizando o ChatGPT para planejar o ataque.

A OpenAI afirmou que suas políticas estão em constante evolução e que a empresa está comprometida em melhorar seus sistemas de identificação de riscos. Os processos buscam indenização não divulgada e mudanças nas regras de segurança da empresa.

OpenAI enfrenta ações na Justiça

As ações judiciais relacionadas ao tiroteio em Tumbler Ridge são parte de uma série de processos contra a OpenAI, que alegam que o ChatGPT incentivou comportamentos perigosos. Esses casos estão em fase inicial e levantam questões sobre a responsabilidade da empresa em relação à violência promovida por seus usuários.

A OpenAI negou as acusações e, no caso de um assassinato seguido de suicídio, afirmou que o autor já tinha um histórico de problemas mentais. A discussão sobre a responsabilidade das plataformas de inteligência artificial em casos de violência está apenas começando a ser explorada nos tribunais.