IA emocional avalia felicidade dos funcionários durante o trabalho

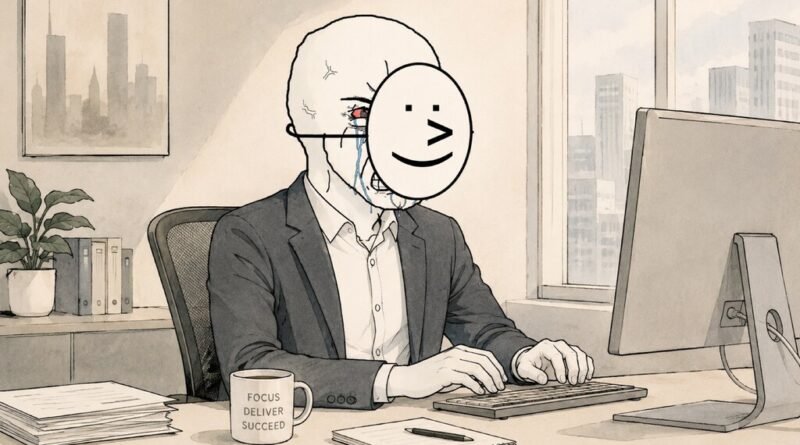

O monitoramento emocional no trabalho avança com a inteligência artificial.

As empresas têm uma longa história de monitoramento de seus funcionários, iniciando com o ponto eletrônico e evoluindo para o registro de pressionamentos de teclado e movimentações do mouse. Atualmente, uma nova geração de softwares de vigilância emocional analisa a expressão facial dos trabalhadores para determinar se estão mantendo uma atitude positiva enquanto desempenham suas funções.

Essa tecnologia, conhecida como “IA emocional” ou computação afetiva, vai além da simples medição da produtividade, buscando quantificar o estado emocional dos colaboradores durante o trabalho. Ferramentas como MorphCast, HireVue e a integração Aware para Slack têm se aprimorado ao longo dos anos, utilizando análises em tempo real de videoconferências para avaliar níveis de atenção e emoção. Outras soluções processam transcrições de chats para inferir o clima emocional de uma equipe, enquanto algumas monitoram o tom de voz em chamadas de atendentes de call center. Empresas como MetLife, Burger King e McDonald’s já adotaram ou estão testando essas tecnologias.

O mercado global de IA emocional já ultrapassou 3 bilhões de dólares, com previsões indicando que esse valor deve triplicar até 2030.

Eficiência ou invasão?

A base científica que sustenta essa indústria é controversa. Muitos sistemas se fundamentam na teoria das emoções básicas do psicólogo Paul Ekman, que identifica seis emoções universais reconhecíveis em expressões faciais. No entanto, essa teoria tem sido amplamente debatida e contestada na academia.

A neurocientista Lisa Feldman Barrett argumenta que as expressões faciais não possuem um significado emocional fixo, mas sim relacional, dependendo do contexto, da cultura e da fisiologia de cada indivíduo.

Por exemplo, um funcionário que franze a testa por estar concentrado pode ser mal interpretado como irritado. Da mesma forma, um colaborador que demonstra tristeza ao interagir com um cliente pode ser penalizado por falta de cordialidade.

Os sistemas de reconhecimento emocional e os modelos de linguagem são suscetíveis a preconceitos presentes nos dados utilizados para seu treinamento. Um estudo revelou que uma IA de reconhecimento emocional tendia a classificar jogadores negros da NBA como mais irritados do que seus colegas brancos, mesmo quando estavam sorrindo.

Implicações éticas

Há uma lógica de mercado evidente nessa evolução. O escritor Cory Doctorow sugere que tecnologias de monitoramento mais invasivas tendem a ser implementadas inicialmente em setores com trabalhadores mais vulneráveis, normalizando-se antes de se espalharem para outras áreas. O ciclo começa com caminhoneiros, avança para atendentes de call center e, por fim, alcança trabalhadores de escritório.

A União Europeia já tomou medidas para proibir o uso de IA emocional no ambiente de trabalho, exceto para propósitos médicos ou de segurança. Nos Estados Unidos, a legislação permite que empregadores monitorem uma ampla gama de atividades de seus funcionários durante o horário de trabalho, em propriedades ou dispositivos da empresa.

As empresas desenvolvedoras dessas tecnologias argumentam que os seres humanos também são suscetíveis a preconceitos, e que as avaliações subjetivas de um chefe são tão falíveis quanto as de um algoritmo. Contudo, a automatização da vigilância emocional altera a dinâmica: não se trata mais de um supervisor percebendo o desânimo de um funcionário, mas de um sistema que analisa todas as interações e registra cada detalhe.