Prompt injection e o uso de ‘código secreto’ por advogadas para tentar sabotar processos

Juiz impõe multa de R$ 84 mil a advogadas por tentativa de manipulação de IA em processo judicial.

A prática de manipulação de respostas de assistentes de inteligência artificial, conhecida como “prompt injection”, levou a uma severa punição no âmbito judicial.

As advogadas Alcina Medeiros e Luanna Alves foram multadas em R$ 84,2 mil após tentarem inserir um comando em uma petição para que a IA do Tribunal Regional do Trabalho da 8ª Região (TRT-8) analisasse um documento de maneira superficial.

O juiz Luis Carlos de Araujo Santos Júnior, responsável pelo caso em Parauapebas (PA), classificou a ação como um “ato contra a dignidade da Justiça”, destacando a gravidade da tentativa de manipulação.

A injeção de comandos é uma técnica que utiliza textos enganosos para influenciar as respostas de assistentes de IA, visando forçar esses sistemas a realizarem ações inadequadas ou a ignorarem verificações de segurança.

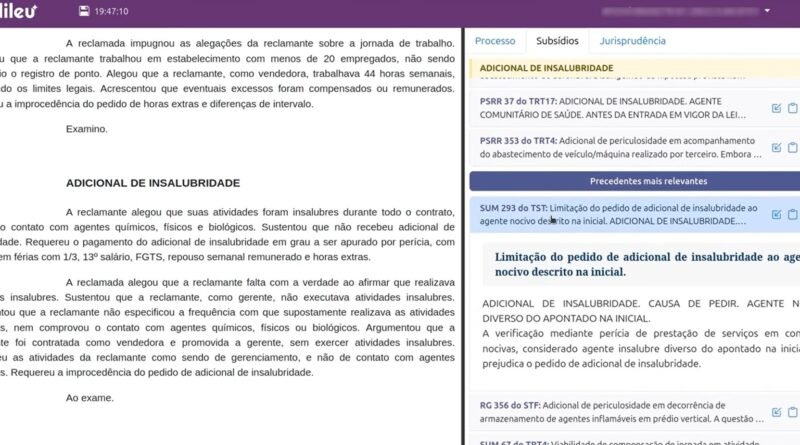

No caso específico das advogadas, o objetivo era adulterar a inteligência artificial chamada Galileu, utilizada pelo tribunal, para que esta apresentasse análises superficiais, prejudicando a argumentação contrária ao documento em questão.

Para efetivar a manipulação, foi inserido no arquivo um texto oculto que instruía a IA a contestar a petição de forma superficial, sem impugnar os documentos, independentemente de qualquer comando que lhe fosse dado.

Em resposta à decisão judicial, as advogadas manifestaram sua discordância, alegando que nunca houve intenção de manipular a decisão judicial, mas sim de proteger o cliente da própria IA, e informaram que pretendem recorrer da sentença.

O assistente Galileu conseguiu detectar os comandos ocultos durante a análise do documento e emitiu um alerta, conforme informações do Tribunal Regional do Trabalho da 4ª Região (TRT-4), que desenvolveu a ferramenta.

As ações corretivas foram tomadas apenas após uma verificação humana, baseada no aviso do assistente, que não qualificou a conduta das advogadas nem sugeriu ações para o processo.

Prompt injection em ataques cibernéticos

A tentativa de manipulação realizada pelas advogadas representa apenas um exemplo das diversas formas de injeção indevida de comandos em assistentes de IA.

Hackers têm utilizado essa tática para tentar forçar sistemas a revelarem dados confidenciais ou a não seguirem os controles de segurança estabelecidos por seus desenvolvedores.

A injeção de comandos pode ser classificada em dois tipos: a indireta, como a utilizada pelas advogadas, onde o texto é inserido em um documento analisado pelo assistente, e a direta, onde os comandos são enviados diretamente na interface de texto do assistente.

Os ataques de prompt injection foram identificados em 2022, quando pesquisadores de uma empresa de cibersegurança alertaram sobre falhas em grandes modelos de linguagem, levando a uma crescente preocupação no setor com essa vulnerabilidade.

Desde então, a injeção de comandos tem sido um tema de atenção para especialistas em cibersegurança, dada a sua potencialidade de causar danos significativos em diversos contextos, incluindo o jurídico.